험한 것이 나왔다...자비스 콜링

바로 며칠 전인 5월 13일에 OpenAI가 또 새로운 GPT모델을 발표했다.

https://openai.com/index/hello-gpt-4o/

페이지에 들어가면 시연 영상도 다양하게 볼 수 있다.

영상을 보면 이번 모델 GPT-4o는 단순히 입력한 Text에 대한 답을 내놓는 수준은 아득히 넘어서서 카메라 너머의 세상을 보고, 말을 듣고 이를 바탕으로 말을 한다. 근데 말할 때 악센트나 중간중간 웃는거나 뭔 가위바위보 심판까지 봐주는거 보면 그냥 사람이랑 영상통화하는걸로 보인다. 이걸 어떻게 했지...

물론 우리가 사용하면 소개 영상처럼은 안될거 같다. 나도 이미지 생성형 AI에서 소개 페이지 결과물만 보고 현혹돼서 몇 번 더 사용해봤다가 실망 정말 많이 했었던 경험이 있어서...100% 믿지는 못하겠는데 그래도 이걸 시작으로 더 발전해나갈 거 생각하면 대단하긴 하다.

OpenAI의 GPT-4o 소개 페이지의 말을 쫙 번역해서 정리해보면

- 텍스트, 오디오, 이미지 및 비디오의 모든 조합을 입력으로 받아들이고 텍스트, 오디오 및 이미지 출력의 모든 조합을 생성한다.

- 오디오 입력에 대해 최소 232ms, 평균 320ms만에 응답할 수 있어서 인간의 응답시간과 비슷하다.

- 영어와 코드에 대한 텍스트 처리에 대해서는 GPT-4 Turbo 성능과 맞먹으며, 비영어 텍스트 처리에 대해서도 상당한 개선을 보였으며, 속도는 훨씬 더 빨라졌고, API 사용시 50% 저렴하다.

- GPT-4o는 기존 모델에 비해 시각 및 오디오 이해 능력이 특히 더 뛰어나다.

그러니까 보고 들은 것을 바탕으로 말하고 글쓰고 이미지를 보여줄 수도 있는데 이걸 인간만큼 빨리 해주게 되었다는 것이다. 외계인이 와서 만들었나...

그리고 더 번역해서 살펴보자면

사실 GPT-4o가 나오기 전에도 Voice Mode로 ChatGPT와 대화할 수는 있었지만 시간이 오래 걸렸다. Voice Mode는 3개의 개별 모델로 구성된 파이프 라인을 사용했다.

1. Audio -> Text

2. GPT-3.5 또는 GPT-4가 1번의 결과 text를 받아서 output text를 출력하고

3. 2번의 output text -> Audio

이 3번의 과정을 거치면서 GPT-4는 많은 정보를 잃게 된다. 말할 때의 톤, 다수의 화자, 배경 소음을 직접 관찰할 수 없으며 웃음, 노래 또는 감정 표현을 출력할 수 없기 때문이다.

이 단점을 해결하기 위해 GPT-4o에서는 Text, Vision, Audio를 처리하는 하나의 모델을 학습시켰다. 즉, 모든 입력과 출력이 동일한 신경망에 의해 처리된다는 것이다. GPT-4o는 이런 modality들을 결합한 첫 번째 모델이기 때문에 우리가 이 모델이 할 수 있는 일과 그 한계를 탐구하는 일에 있어서는 아직 초기 단계에 있다고 할 수 있다.

원래 음성으로도 ChatGPT와 대화를 할 수는 있었지만 이전 버전에서는 음성을 텍스트로 변환시켜서 GPT모델에 넣고, 그 결과물로 나온 텍스트를 다시 음성으로 변환해서 들려줬었다. 음성에서 텍스트로, 또는 그 반대로 변환하며 반언어적 표현이 사라지거나 다수의 화자가 1명이 되어버리고는 했는데, GPT-4o에서는 동일한 신경망이 입출력을 모두 처리하도록 하며 이런 단점을 없앴다. 화자의 반언어적, 비언어적 표현을 모두 반영하여 output을 내놓을 수 있게 됐다는 것이다.

그리고 또 하나 개선된 점이 있다.

Language tokenization

Language tokenization These 20 languages were chosen as representative of the new tokenizer's compression across different language families

이게 무슨 뜻이냐면 텍스트를 작은 단위로 나누는 도구인 토크나이저의 압축 성능이 개선되었다는 말이다.

토크나이저는 텍스트를 단어, 부분 단어 또는 기타 의미 있는 단위로 분할해서 LLM이 이해할 수 있도록 만들어주는 도구이다. LLM에 넣을 수 있는 토큰의 개수는 제한적이기 때문에 텍스트를 얼마나 적은 토큰으로 압축할 수 있는지(압축 효율성)가 매우 중요하다. 압축 효율성을 높이면 모델의 처리 속도와 메모리 사용량을 개선할 수 있다.

근데 이런 모델이 악용되면 매우 위험할 거라는건 나도 알고, OpenAI도 알고, 모두가 알고 있겠다

Model safety and limitations

이 제목 아래를 읽어보면 어떻게 안전 관련 이슈를 해결하려 노력하고 있는지와 현재 GPT-4o 모델의 한계점를 알 수 있다. 안전..하겠지??

그리고 제일 중요한거

쓸 수 있냐?

모델 이용 가능성

GPT-4o는 이번에 실용성을 중심으로 딥러닝의 한계를 확장하는 최신 단계입니다. 우리는 지난 2년 동안 스택의 모든 계층에서 효율성 개선 작업에 많은 노력을 기울였습니다. 이 연구의 첫 성과로, 우리는 GPT-4 수준의 모델을 훨씬 더 폭넓게 제공할 수 있게 되었습니다. GPT-4o의 기능은 단계적으로 출시될 예정이며, 오늘부터 확장된 리팀 액세스가 시작됩니다.

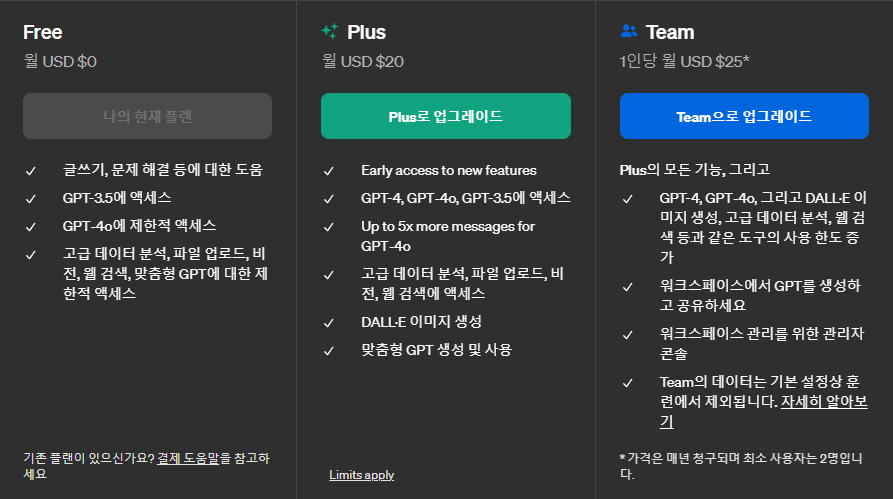

GPT-4o의 텍스트 및 이미지 기능은 오늘부터 ChatGPT에서 단계적으로 출시됩니다. 우리는 무료 티어에서도 GPT-4o를 이용할 수 있게 하며, Plus 사용자는 최대 5배 더 많은 메시지 제한을 제공받게 됩니다. 몇 주 내에 ChatGPT Plus에서 GPT-4o를 사용하는 새로운 버전의 Voice Mode를 알파 단계로 출시할 예정입니다.

개발자들도 이제 GPT-4o를 텍스트 및 비전 모델로 API에서 사용할 수 있습니다. GPT-4o는 GPT-4 Turbo에 비해 2배 빠르고, 비용은 절반이며, 속도 제한은 5배 더 높습니다. 우리는 GPT-4o의 새로운 오디오 및 비디오 기능을 몇 주 내에 소수의 신뢰할 수 있는 파트너에게 API를 통해 지원할 계획입니다.

그렇답니다

무료 버전도 GPT-4o를 사용할 수 있기는 하다. 그런데 이제 "제한적" 단어가 더해진....

돈 벌면 Plus 사본다.

졸프한다고 한창 Text-to-Image 모델만 들여다볼 때도 이쪽 분야도 성장 속도가 거의 죽순 수준이라서 찾아볼 때마다 놀랐던 기억이 있는데 진짜 봐도봐도....성장 속도가 놀랍다. 앞으로 어떻게 더 성장할지 예상도 안되는데 기대된다.